16.03.2026

Big Data: qué es, cómo funciona y por qué lo necesitas

Qué es el Big Data y cómo puede ayudar a una empresa.

Pedro Cailá

El big data es el análisis de conjuntos de datos masivos y complejos que las herramientas tradicionales, como una hoja de cálculo, no pueden procesar. Su objetivo no es acumular datos, sino encontrar patrones ocultos, predecir comportamientos y tomar decisiones basadas en evidencia, no en intuición.

Qué es big data y por qué redefine la toma de decisiones

El big data no es simplemente tener «muchos datos». Es un cambio de mentalidad: dejas de analizar el pasado para anticipar el futuro. La diferencia es como comparar las notas de una reunión con la grabación completa. Las notas dan los puntos clave; la grabación capta cada matiz. Los informes de ventas son esas notas. El big data es la grabación completa de todo lo que ocurre en tu negocio.

El universo de datos que puedes analizar

Esta «grabación completa» proviene de fuentes diversas que, al combinarlas, ofrecen una visión panorámica de tu negocio. Estas fuentes incluyen:

- Datos de comportamiento web: Cada clic, cada scroll, el tiempo que un usuario se detiene en un producto.

- Interacciones en redes sociales: Comentarios, likes, menciones y el sentimiento asociado a tu marca.

- Logs de servidores y aplicaciones: Registros técnicos que revelan patrones de uso o alertan sobre fallos inminentes.

- Datos de sensores (IoT): Información en tiempo real de maquinaria, vehículos o dispositivos wearables.

Al procesar esta información, las empresas logran resultados antes impensables. Un e-commerce puede personalizar recomendaciones a un nivel individual. Una empresa de logística puede recalcular rutas al minuto para optimizar el consumo de combustible.

El poder del big data no reside en los terabytes almacenados, sino en las preguntas de negocio que te permite responder. Es pasar del «¿qué vendimos el mes pasado?» al «¿qué cliente está a punto de irse y qué oferta específica podemos hacerle para retenerlo?».

La oportunidad en el mercado español

En España, el potencial del big data está mayoritariamente sin explotar. Actualmente, solo el 11% de las empresas españolas lo utilizan de forma habitual.

Sin embargo, la agenda España Digital 2026 tiene como meta que esa cifra alcance el 25%. Esto indica un claro impulso gubernamental y una oportunidad competitiva para las empresas que actúen ahora.

Adoptar una cultura de datos es una ventaja decisiva. No se trata de comprar un software, sino de integrar el análisis en cada decisión estratégica. A menudo se confunde con el Business Intelligence (BI), pero sus enfoques son distintos. Puedes ver las diferencias en nuestro artículo sobre qué es Business Intelligence y por qué se queda corto frente al big data.

Las 5 Vs que definen una estrategia de big data exitosa

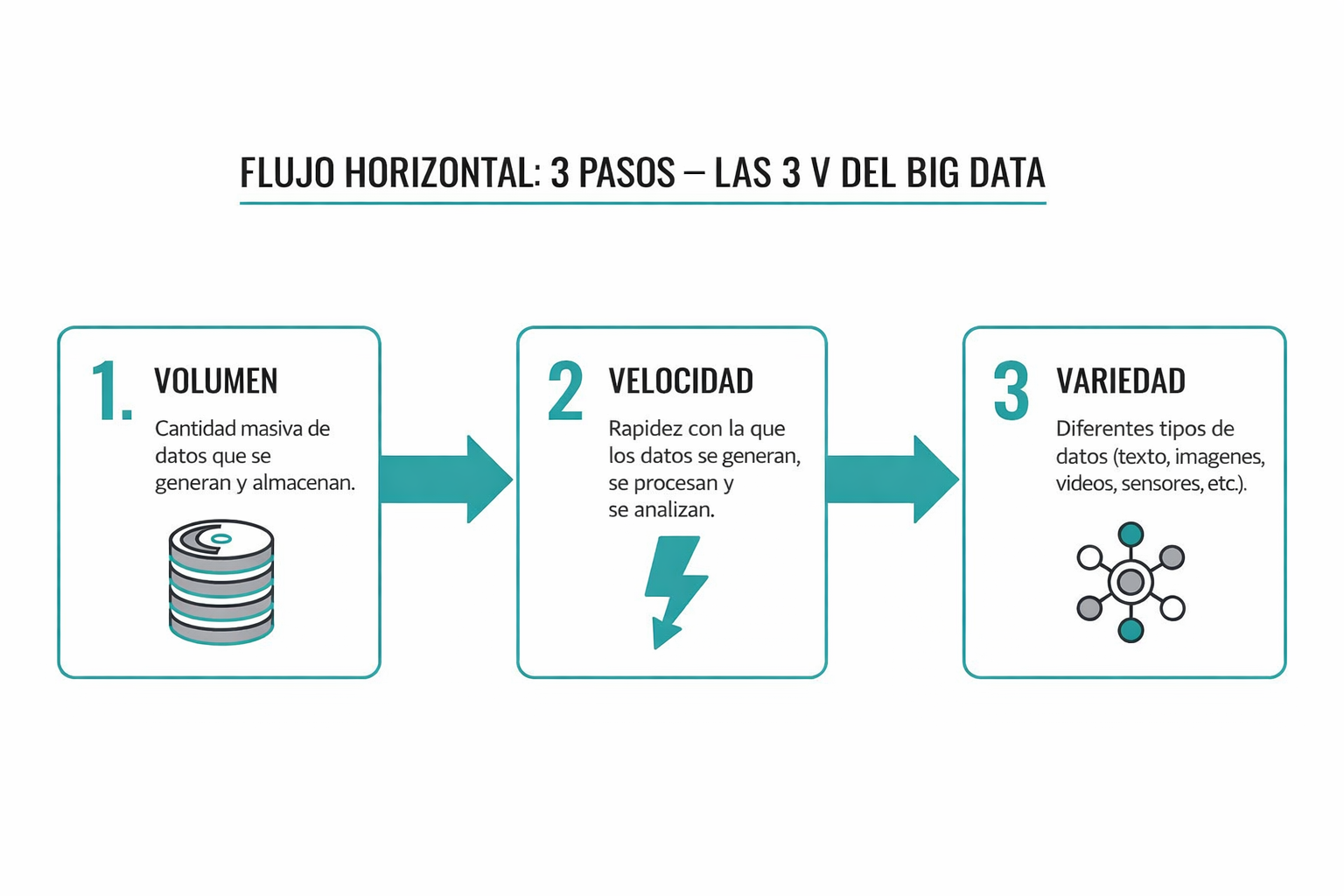

Para que el big data sea una herramienta práctica, debes dominar las 5 Vs que lo definen. No son conceptos teóricos, sino criterios que determinan si tu estrategia de datos funcionará. El modelo original incluía tres (Volumen, Velocidad y Variedad), pero la experiencia ha demostrado que la Veracidad y el Valor son cruciales.

Volumen: la escala de los datos

El volumen es la primera característica: cantidades de datos que las herramientas convencionales no pueden manejar. Hablamos de terabytes, petabytes y exabytes. Por ejemplo, una flota de vehículos de logística puede generar terabytes de datos de GPS diariamente. Analizar este volumen permite optimizar rutas en tiempo real, algo imposible con un Excel.

Velocidad: la necesidad de inmediatez

La velocidad es la rapidez con la que los datos se generan y, más importante, la rapidez con la que necesitas actuar sobre ellos. En muchos negocios, el valor de un dato caduca en segundos. Una fintech que analiza transacciones en milisegundos para detectar fraudes es un claro ejemplo. Si una tarjeta se usa en Madrid y dos minutos después en Singapur, el sistema la bloquea al instante. Aquí, la velocidad es el negocio.

Variedad: la gestión de la complejidad

La variedad se refiere a los distintos formatos de datos. El big data no solo trabaja con números en tablas (datos estructurados), sino también con textos, imágenes, vídeos o audios (datos no estructurados). Una startup de MarTech combina datos de su CRM (estructurados) con comentarios en redes sociales o transcripciones de llamadas (no estructurados) para obtener una visión 360 del cliente que los números por sí solos no proporcionan.

Veracidad: la confianza en los datos

La veracidad se resume en una pregunta: ¿te puedes fiar de tus datos? De nada sirve procesar volúmenes masivos a gran velocidad si la información es incorrecta o incompleta. La regla de oro es "basura entra, basura sale". Una HealthTech que entrena una IA para diagnosticar enfermedades depende al 100% de la exactitud de los historiales clínicos. Un solo error puede sesgar el modelo y llevar a diagnósticos erróneos, lo que exige una fuerte inversión en limpieza y gobernanza de datos.

Valor: el objetivo final de negocio

El valor es la "V" más importante, el ROI de tu infraestructura de datos. ¿Para qué analizar petabytes si no se traduce en una mejora medible para el negocio? Imagina una empresa SaaS que descubre que los usuarios de una función específica tienen un 30% menos de probabilidad de darse de baja. Ese insight es oro: permite al equipo de producto enfocar sus esfuerzos en potenciar esa funcionalidad para mejorar la retención. Ahí es donde el big data pasa de ser un coste a un motor de crecimiento.

El pipeline de datos: el recorrido que siguen los expertos

Para extraer valor del big data, hay que entender su ciclo de vida como un proceso industrial: una materia prima (datos en bruto) se transforma paso a paso en una decisión de negocio. Este proceso, o pipeline, se divide en cinco fases.

1. Ingesta: la captura de los datos

Todo comienza con la captura fiable de datos desde múltiples fuentes, como APIs, logs de aplicaciones, bases de datos o sensores IoT. El sistema de ingesta debe ser robusto y capaz de gestionar picos de información sin perder un solo dato, ya que la calidad de todo el proceso depende de esta primera fase.

2. Almacenamiento: data lakes vs. data warehouses

Una vez capturados, los datos necesitan un lugar donde guardarse. La elección entre un Data Lake y un Data Warehouse depende del uso que se les dará.

Un Data Lake es un repositorio que almacena todos los datos en su formato original, sin procesar. Es ideal para que los científicos de datos exploren y busquen patrones inesperados.

Un Data Warehouse contiene únicamente datos limpios y estructurados, listos para ser consultados. Es perfecto para generar informes y responder a preguntas de negocio conocidas de forma rápida.

En la práctica, las arquitecturas más potentes combinan ambos: el Data Lake para la exploración y el Data Warehouse para la velocidad y fiabilidad de los informes.

3. Procesamiento: transformando el caos en orden

Los datos en el Data Lake están en bruto: incompletos, con errores o en formatos inconsistentes. En la fase de procesamiento se limpian, enriquecen y transforman para que sean útiles. Herramientas como Apache Spark son el estándar para este trabajo, permitiendo procesar volúmenes masivos en paralelo, aplicar reglas de negocio y unificar datos de distintas fuentes.

Como muestra la imagen, todo el pipeline debe estar diseñado para gestionar el volumen, la velocidad y la variedad de los datos. Un fallo en cualquiera de estas dimensiones compromete el resultado final.

4. Análisis: de los datos a las respuestas

Con los datos limpios y estructurados, llega el análisis. Aquí se aplican técnicas para responder preguntas de negocio:

- Análisis Descriptivo: Responde al "¿Qué ha pasado?" (Ej: informes de ventas).

- Análisis Predictivo: Intenta adivinar el futuro usando machine learning (Ej: predecir qué clientes se darán de baja).

- Análisis Prescriptivo: Recomienda acciones (Ej: sugerir la mejor oferta para retener a un cliente en riesgo).

El rol del ingeniero de datos es fundamental, ya que construye y mantiene la infraestructura que hace posibles estos análisis.

5. Visualización: contando la historia que hay detrás de los números

El último paso es la visualización. Un análisis brillante no sirve de nada si quienes toman decisiones no lo entienden. Herramientas como Tableau, Power BI o Looker Studio traducen los datos en gráficos y dashboards interactivos. El objetivo es contar una historia que responda a preguntas de negocio y permita a un directivo tomar una decisión informada sin necesidad de conocimientos técnicos.

Cómo elegir entre la arquitectura Lambda y Kappa

Lambda o Kappa es la gran decisión de arquitectura al diseñar una infraestructura de datos. No hay una respuesta correcta, solo la que mejor encaja con tu negocio. Ambas buscan procesar datos a gran escala y en tiempo real, pero difieren en cómo manejan el análisis de históricos (batch) frente a la información instantánea (streaming).

Arquitectura Lambda, la solución de dos vías

La arquitectura Lambda es la opción robusta y a prueba de fallos. Divide el trabajo en dos caminos paralelos:

- La capa lenta (Batch Layer): Procesa periódicamente grandes volúmenes de datos históricos para crear una visión completa y 100% precisa, la "fuente única de la verdad".

- La capa rápida (Speed Layer): Procesa los datos en tiempo real para ofrecer una visión inmediata, aunque sea una aproximación.

Los resultados de ambas capas se unen para ofrecer una visión completa. Su ventaja es la fiabilidad y precisión histórica. Su desventaja es la complejidad operativa, al tener que mantener dos sistemas y bases de código.

Arquitectura Kappa, la simplicidad del streaming

La arquitectura Kappa simplifica el proceso con una filosofía clara: todo es un stream de datos. Elimina la capa batch, argumentando que un sistema de streaming lo suficientemente rápido y capaz de reprocesar datos la hace innecesaria.

En Kappa, solo hay una vía para los datos:

- La capa de Streaming: Todos los datos, históricos o en tiempo real, pasan por la misma lógica y sistema, como Apache Kafka o Apache Flink. Para obtener una vista histórica, simplemente se "rebobina" y reprocesa el flujo.

Su mayor fortaleza es la simplicidad: unifica el código y acelera el desarrollo. Es ideal cuando la velocidad y la inmediatez son la prioridad absoluta.

Un escenario práctico: un e-commerce

Imagina que diseñas la infraestructura de datos para un e-commerce.

- Si el objetivo es analizar ventas trimestrales y ofrecer recomendaciones de productos en tiempo real, la arquitectura Lambda es la apuesta segura. La capa batch generará informes históricos precisos, mientras que la capa de velocidad impulsará las recomendaciones en vivo.

- Si el objetivo es detectar fraude en pagos, la arquitectura Kappa es perfecta. El sistema necesita decidir en milisegundos si una transacción es sospechosa, y la velocidad y simplicidad son críticas. La información histórica tiene menos relevancia en este caso de uso.

Casos de uso de big data que generan un ROI demostrable

El valor del big data se mide en resultados de negocio. Veamos aplicaciones concretas que generan un impacto real y justifican la inversión.

Retail y e-commerce

El retail ha revolucionado la personalización. Los sistemas de recomendación analizan el historial de compras, la navegación web y el comportamiento de usuarios similares para crear sugerencias muy precisas. Una buena implementación puede aumentar el valor medio del carrito (AOV) hasta en un 25%.

Otro caso de uso es la optimización dinámica de precios. Los algoritmos ajustan los precios en tiempo real basándose en datos de la competencia, la demanda y el inventario para maximizar el margen.

La digitalización, impulsada por big data e IA, creará 480.000 empleos netos en España para 2026. En retail, la personalización puede impulsar un crecimiento de ventas del 22,8% anual. Puedes leer más en el informe completo sobre la digitalización y el empleo.

Fintech

En el sector financiero, la velocidad es clave. Las fintech usan modelos que analizan millones de transacciones por segundo para detectar patrones de fraude en tiempo real. Estos sistemas aprenden el comportamiento "normal" de un usuario y alertan instantáneamente ante cualquier anomalía.

El objetivo es prevenir el fraude, no solo detectarlo. Un modelo bien entrenado puede bloquear una transacción sospechosa antes de que se complete, ahorrando millones.

Las métricas de éxito son claras:

- Reducción de falsos positivos.

- Disminución de pérdidas por fraude.

- Tiempo de detección en milisegundos.

Logística

Para una empresa de logística, cada kilómetro cuenta. El big data permite optimizar rutas de reparto analizando en tiempo real variables como el tráfico, el clima, los horarios de entrega y la capacidad de los vehículos. Una optimización bien ejecutada puede lograr una reducción de hasta el 15% en costes de combustible y aumentar significativamente el número de entregas por vehículo.

HealthTech

El sector salud usa big data para avanzar hacia una medicina personalizada. Combinando datos genómicos, historiales clínicos y datos de wearables, se crean modelos que identifican pacientes con alto riesgo de desarrollar ciertas enfermedades o predicen qué tratamiento será más eficaz para una persona concreta. Esto no solo mejora la vida de los pacientes, sino que también optimiza el gasto sanitario.

Cómo construir y evaluar equipos de datos de alto rendimiento

Una estrategia de datos es inútil sin el equipo adecuado para ejecutarla. Montar un equipo de alto rendimiento no es un reto de recruiting, sino de visión de negocio: se trata de ensamblar roles complementarios que entiendan cómo su trabajo impacta en el ROI.

El mercado de Big Data en España alcanzará los 3.600 millones de euros en 2025. Este crecimiento impulsa la demanda de talento y obliga a las empresas a protegerse ante riesgos como el aumento del 25% en ciberataques. Puedes leer más en el análisis del mercado de big data en España.

Los cuatro roles clave en un equipo de datos moderno

Un equipo de datos funcional se basa en cuatro roles con misiones claras:

- Data Engineer (Ingeniero de datos): El arquitecto. Construye y mantiene las "autopistas" por las que viajan los datos, asegurando un flujo fiable, rápido y escalable.

- Data Analyst (Analista de datos): El traductor. Convierte datos limpios en respuestas a preguntas de negocio, creando dashboards e informes.

- Data Scientist (Científico de datos): El explorador. Usa los datos para encontrar patrones ocultos y construir modelos predictivos. Responde a "¿qué pasará?". Tenemos una guía completa sobre qué hace y cómo contratar a los mejores científicos de datos.

- ML Engineer (Ingeniero de Machine Learning): El industrializador. Convierte los modelos experimentales del Data Scientist en sistemas de producción estables y monitorizados.

Un error común es contratar a un Data Scientist esperando que construya la infraestructura. Es como pedirle a un piloto de Fórmula 1 que diseñe y asfalte el circuito.

Las habilidades que de verdad importan

Más allá de los roles, un buen profesional de datos combina competencias técnicas con una mentalidad de negocio.

Habilidades técnicas críticas:

- Dominio de Python y SQL: Son los lenguajes universales para manipular datos y crear modelos.

- Experiencia con herramientas de Big Data: Conocer Apache Spark es indispensable para procesar grandes volúmenes de datos.

- Soltura en la nube (Cloud): La mayoría de las infraestructuras modernas corren sobre AWS, Google Cloud o Azure. Un buen candidato debe tener experiencia práctica en estos entornos.

Habilidades blandas (las más difíciles de encontrar):

- Enfoque de negocio: La capacidad de entender el problema comercial detrás de una petición técnica. Un gran profesional pregunta "¿qué decisión necesitas tomar?", no "¿qué datos quieres?".

- Pensamiento crítico: La habilidad para cuestionar los datos, identificar sesgos y ser honesto sobre las limitaciones de un modelo.

- Comunicación clara: Saber explicar un concepto técnico a una audiencia no técnica es lo que convierte un insight en una acción.

Preguntas frecuentes sobre big data

Respondemos a las dudas más comunes sobre big data para que puedas tomar decisiones informadas.

¿Cuál es la diferencia real entre big data y business intelligence?

La diferencia fundamental está en las preguntas que responden. El business intelligence (BI) se centra en datos estructurados del pasado para contestar: ¿qué ha pasado?. Es una radiografía de la situación actual.

El big data utiliza un universo de datos mucho más amplio y complejo para responder: ¿por qué ha pasado?, ¿qué va a pasar? (predicción) y ¿qué deberíamos hacer al respecto? (prescripción).

En resumen: el BI mira por el retrovisor, mientras que el big data ilumina la carretera que tienes por delante.

¿Necesito un presupuesto enorme para empezar a usar big data?

No. Gracias a servicios en la nube como AWS, Google Cloud o Azure, el modelo de pago por uso ha democratizado el acceso. Ya no es necesaria una inversión millonaria en servidores para empezar.

La estrategia inteligente es empezar con un proyecto piloto enfocado en un problema de negocio específico. Demuestra el ROI con una inversión controlada y, con resultados en mano, será fácil justificar la expansión.

¿Cómo sé si mi empresa está de verdad preparada para el big data?

Tu empresa está lista si respondes "sí" a estas tres preguntas:

- ¿Tienes un problema de negocio claro que crees que los datos podrían resolver?

- ¿Generas o tienes acceso a datos que actualmente no estás utilizando (logs, datos de navegación, etc.)?

- ¿Existe un compromiso en el liderazgo para adoptar una cultura basada en datos y experimentar?

No necesitas un plan maestro desde el principio. La voluntad de probar y aprender de los resultados es el ingrediente más importante para empezar con éxito.